#

태그: qwen

모두 보기 태그.

Fine-tuning 튜토리얼

Qwen Fine-tuning

이 튜토리얼은 MoAI Platform에서 오픈 소스 Qwen1.5 7B 모델을 fine-tuning 하는 예시를 소개합니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

1. Fine-tuning 준비하기

MoAI Platform에서 PyTorch 스크립트 실행 환경을 준비하는 것은 일반적인 GPU 서버에서와 크게 다르지 않습니다. 단, 튜토리얼 진행을 위해 아래의 사양들이 권장됩니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

2. Moreh의 학습 코드 톺아보기

학습 데이터를 모두 준비하셨다면 다음으로는 실제 fine-tuning 과정을 실행할 train_qwen.py 스크립트의 내용에 대해 살펴 보겠습니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

3. 학습 실행하기

이제 실제로 fine tuning을 실행해 보겠습니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

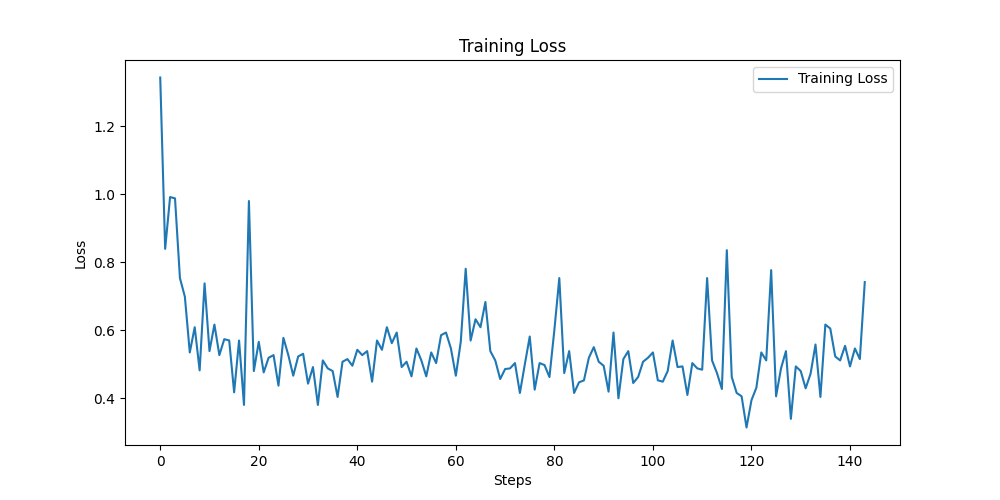

4. 학습 결과 확인하기

앞 장과 같이 train_qwen.py 스크립트를 실행하면 결과 모델이 qwen_code_generation 디렉터리에 저장됩니다. 이는 순수한 PyTorch 모델 파라미터 파일로, MoAI Platform이 아닌 일반 GPU 서버에서도 완벽히 호환됩니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

5. GPU 개수 변경하기

앞과 동일한 fine tuning 작업을 GPU 개수를 바꾸어 다시 실행해 보겠습니다. MoAI Platform은 GPU 자원을 단일 가속기로 추상화하여 제공하며 자동으로 병렬 처리를 수행합니다.

Fine-tuning 튜토리얼 • Qwen Fine-tuning

6. 마무리

지금까지 MoAI Platform에서 Qwen1.5 7B 모델을 fine-tuning하는 과정을 살펴 보았습니다. MoAI Platform을 사용하면 기존의 학습 코드를 그대로 사용하면서